公开数据集

数据结构 ?

3.85G

数据结构 ?

3.85G

Data Structure ?

Data Structure ?

* 以上分析是由系统提取分析形成的结果,具体实际数据为准。

README.md

HMDB数据集是当前识别动作研究领域最为重要的几个数据集之一。

随着每天近10亿个在线视频的观看,计算机视觉研究的一个新兴前沿领域是视频识别和搜索。尽管人们在收集和注释包含数千种图像类别的大型可伸缩静态图像数据集方面付出了大量努力,但人类行为数据集却远远落后于此。

为此,Brown university大学于2011年发布HMDB51数据集,该数据集视频多数来源于电影,还有一部分来自公共数据库以及YouTube等网络视频库。数据库包含有6849段样本,分为51类,每类至少包含有101段样本。

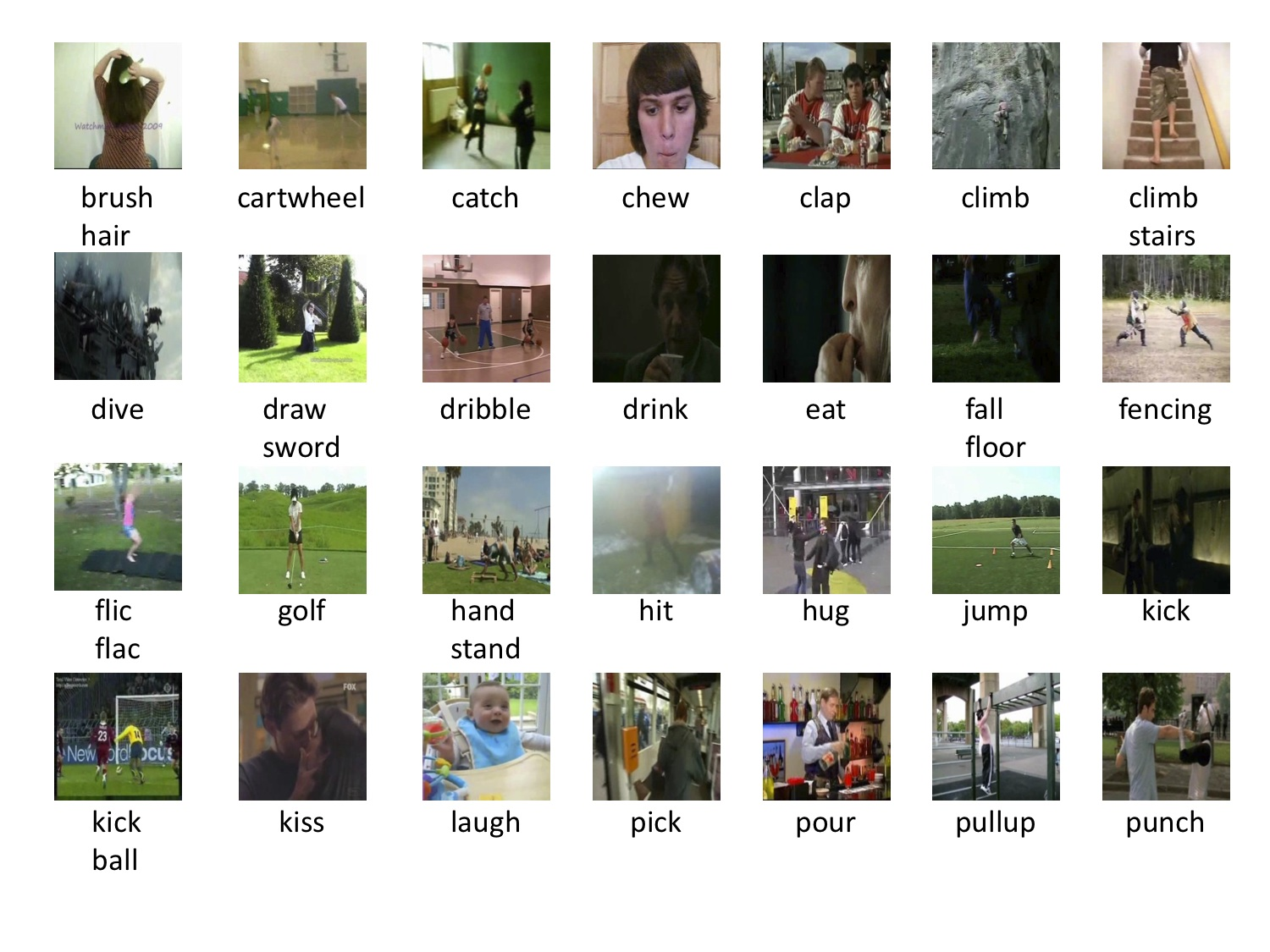

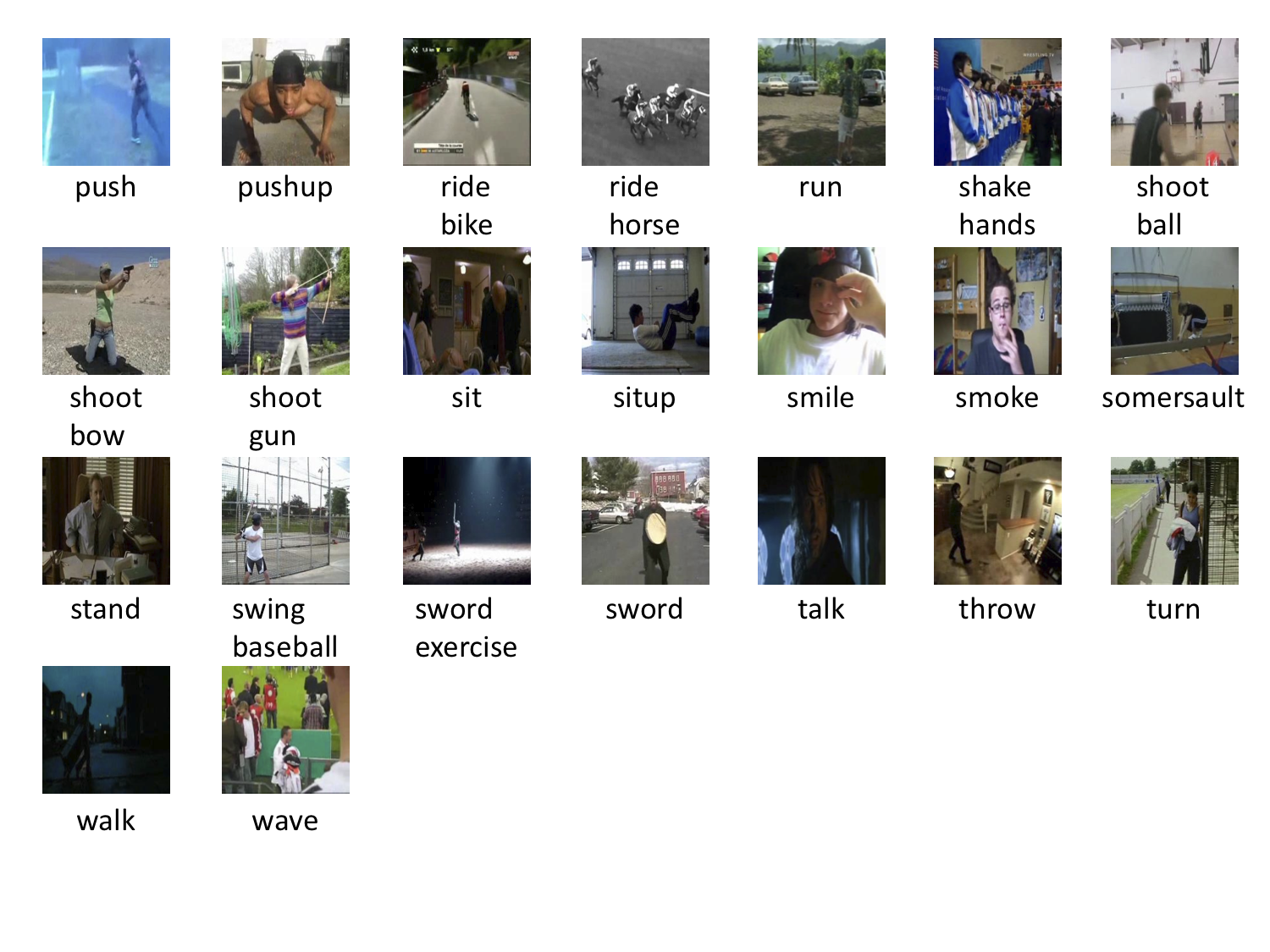

动作主要分为五类:

1)一般面部动作:微笑,大笑,咀嚼,交谈。

2)面部操作与对象操作:吸烟,吃,喝。

3)一般的身体动作:侧手翻,拍手,爬,爬楼梯,跳,落在地板上,反手翻转、倒立、跳、拉、推、跑,坐下来,坐起来,翻跟头,站起来,转身,走,波。

4)与对象交互动作:梳头,抓,抽出宝剑,运球、高尔夫、打东西,球、挑、倒、推东西,骑自行车,骑马,射球,射弓、枪、摆棒球棍、剑锻炼,扔。

5)人体动作:击剑,拥抱,踢某人,亲吻,拳打,握手,剑战。

51个动作的图示:

数据集,元标签,统计:

除了动作类别的标签之外,每个剪辑还带有动作标签以及描述剪辑属性的元标签。因为HMDB51视频序列是从商业电影以及YouTube中提取的,所以它代表了光线条件,情况和周围环境的多种多样,可以使用不同的相机类型和录制技术(例如视点)捕获动作的出现。观点是HMDB支持的另一个细分标准。对于全方位的覆盖,可以从正面,侧面(左右)和向后的角度观察运动。另外,我们有两个不同的类别,即“不运动”和“相机运动”。后者是变焦,旅行镜头和相机晃动等的结果。视频质量的3级分级适用于评估大量剪辑。只有那些视频样本被评为“好”,其质量足以使您在运动过程中识别出单根手指。如果执行动作时身体部位或四肢消失,则不符合此要求的人员将被评定为“中级”或“不良”。您可以在下面找到每个年级的示例,以显示差异。

质量分级示例

| Property | Labels (abbreviation) |

|---|---|

| visible body parts | head(h), upper body(u), full body (f), lower body(l) |

| camera motion | motion (cm), static (nm) |

| camera viewpoint | Front (fr), back (ba), left(le), right(ri) |

| number of people involved in the action | Single (np1), two (np2), three (np3) |

| video quality | good (goo), medium (med), ok (bad) |

动作类别,身体部位,相机动作,视点

剪辑质量,剪辑持续时间,剪辑持续时间计数

与使用从真实世界视频中提取的视频剪辑相关的一个主要挑战是可能存在重大的相机/背景运动,这被认为会干扰局部运动的计算,应予以纠正。为了消除摄像机的运动,我们使用了标准的图像拼接技术来对齐剪辑的帧。这些技术通过检测然后匹配两个相邻帧中的显着特征来估计背景平面。使用包括绝对像素差和所检测点的欧拉距离的距离度量来计算两个帧的对应度。然后匹配具有最小距离的点,并且使用RANSAC算法来估计所有相邻帧之间的几何变换(对于每对帧都是独立的)。使用此估计,可以对单个帧进行扭曲和组合以实现稳定的剪辑。

原始imgs与稳定的imgs

其他动作识别基准

这项工作始于KTH:KTH数据集包含六种类型的动作,每个动作类别包含100个剪辑。其次是在魏茨曼研究所收集的魏茨曼数据集,其中包含十个动作类别和每个类别九个片段。在受控和简化设置下记录了以上两组。然后,从电影中收集并从电影脚本中进行注释的第一个现实动作数据集是在INRIA中创建的;好莱坞人类动作集包含8种类型的动作,每个动作类别的剪辑数量在每个类别60至140之间变化。它的扩展版本Hollywood2 Human Actions Set提供了总共3669个视频,分布在十种类型的场景下的十类人类行为中。 UCF小组还一直在收集动作数据集,大部分是从YouTube收集的。 UCF Sports包含9种运动类型和182个剪辑,UCF YouTube包含11个动作类,UCF50包含50个动作类。我们将在论文中表明,来自YouTube的视频可能会受到低级功能的偏见,这意味着低级功能(即颜色和要点)比中级恐惧(即运动和形状)更具歧视性。

| Dataset | Year | # Actions | # Clips per Action |

|---|---|---|---|

| KTH | 2004 | 6 | 10 |

| Weizmann | 2005 | 9 | 9 |

| IXMAS | 2006 | 11 | 33 |

| Hollywood | 2008 | 8 | 30-140 |

| UCF Sports | 2009 | 9 | 14-35 |

| Hollywood2 | 2009 | 12 | 61-278 |

| UCF YouTube | 2009 | 11 | 100 |

| MSR | 2009 | 3 | 14-25 |

| Olympic | 2010 | 16 | 50 |

| UCF50 | 2010 | 50 | min. 100 |

| HMDB51 | 2011 | 51 | min. 101 |

Contact

For questions about the datasets and benchmarks, please contact Hueihan Jhuang ( hueihan.jhuang [at] tuebingen.mpg.de).

Citation

The benchmark and database are described in the following article. We request that authors cite this paper in publications describing work carried out with this system and/or the video database.

H. Kuehne, H. Jhuang, E. Garrote, T. Poggio, and T. Serre. HMDB: A Large Video Database for Human Motion Recognition. ICCV, 2011.PDF Bibtex

The first benchmark STIP features are described in the following paper and we request the authors cite this paper if they use STIP features.

I. Laptev, M. Marszalek, C. Schmid, and B. Rozenfeld. Learning Realistic Human Actions From Movies. CVPR, 2008. PDF

The second benchmark C2 features are described in the following paper and we request the authors cite this paper if they use C2 codes.

H. Jhuang, T. Serre, L. Wolf, and T. Poggio. A Biologically Inspired System for Action Recognition. ICCV, 2007. PDF

- 分享你的想法

全部内容

数据使用声明:

- 1、该数据来自于互联网数据采集或服务商的提供,本平台为用户提供数据集的展示与浏览。

- 2、本平台仅作为数据集的基本信息展示、包括但不限于图像、文本、视频、音频等文件类型。

- 3、数据集基本信息来自数据原地址或数据提供方提供的信息,如数据集描述中有描述差异,请以数据原地址或服务商原地址为准。

- 1、本站中的所有数据集的版权都归属于原数据发布者或数据提供方所有。

- 1、如您需要转载本站数据,请保留原数据地址及相关版权声明。

- 1、如本站中的部分数据涉及侵权展示,请及时联系本站,我们会安排进行数据下线。

VIP下载(最低0.24/天)

VIP下载(最低0.24/天) 2180浏览

2180浏览 9下载

9下载 2点赞

2点赞 收藏

收藏 分享

分享